Red Hat OpenShift

Red Hat OpenShift: La Plataforma de Kubernetes para Desarrollo de Aplicaciones.

Red Hat OpenShift es una plataforma de contenedores basada en Kubernetes, diseñada para ayudar a las organizaciones a desarrollar, implementar y gestionar aplicaciones en entornos de nube híbrida y multicloud. Ofrece un conjunto completo de herramientas y servicios que facilitan el ciclo de vida completo de las aplicaciones, desde el desarrollo hasta el despliegue y la operación.

Red Hat OpenShift se basa en Red Hat Enterprise Linux, una base probada para aplicaciones empresariales, y es compatible con Red Hat Ansible Automation Platform, lo que permite la automatización dentro y fuera de los clústeres de Kubernetes. Ofrece un conjunto completo de servicios y herramientas operativas y para desarrolladores, incluido el Motor Kubernetes de Red Hat OpenShift, un tiempo de ejecución de contenedores y una variedad de operadores para diversas aplicaciones y servicios.

La plataforma admite múltiples versiones de Kubernetes y proporciona gestión del ciclo de vida, interoperabilidad de software y flexibilidad para elegir entre múltiples versiones admitidas. Además, Red Hat OpenShift ofrece un modelo de suscripción que proporciona acceso a código listo para producción, actualizaciones de seguridad y herramientas de soporte que no están disponibles en ningún otro lugar.

Características Clave de Red Hat OpenShift

- Gestión Multiclúster: Red Hat OpenShift Platform Plus proporciona gestión multiclúster, lo que permite a las organizaciones administrar múltiples clústeres de Kubernetes en diferentes entornos de infraestructura. Esta característica garantiza la consistencia en toda la cadena de suministro de software y mejora la seguridad y el cumplimiento.

- Seguridad Nativa de Kubernetes: Red Hat OpenShift ofrece seguridad nativa de Kubernetes integrada que proporciona gobernanza multiclúster a lo largo del ciclo de vida de la aplicación. Esta característica incluye políticas de red, gestión de secretos y control de acceso basado en roles, asegurando que las aplicaciones sean seguras y cumplan con las normativas.

- Registro Escalable: Red Hat OpenShift incluye un registro central escalable que proporciona una única fuente de verdad de software disponible y lo distribuye eficientemente a múltiples clústeres. Esta característica garantiza que las aplicaciones tengan acceso a las últimas versiones de software y reduce el riesgo de conflictos de versiones.

- Almacenamiento Definido por Software: Red Hat OpenShift ofrece almacenamiento definido por software persistente y servicios de datos esenciales que están integrados y optimizados para la plataforma. Esta característica garantiza que las aplicaciones tengan acceso a un almacenamiento confiable y de alto rendimiento, lo que les permite escalar y manejar cargas de trabajo crecientes.

- Servicios Gestionados: Red Hat OpenShift ofrece servicios gestionados, como Red Hat OpenShift Service on AWS (ROSA) y Azure Red Hat OpenShift, que proporcionan clústeres de Kubernetes completamente gestionados en nubes públicas. Estos servicios permiten a las organizaciones centrarse en el desarrollo e implementación de aplicaciones, en lugar de gestionar la infraestructura.

Orquestación de Contenedores con Kubernetes

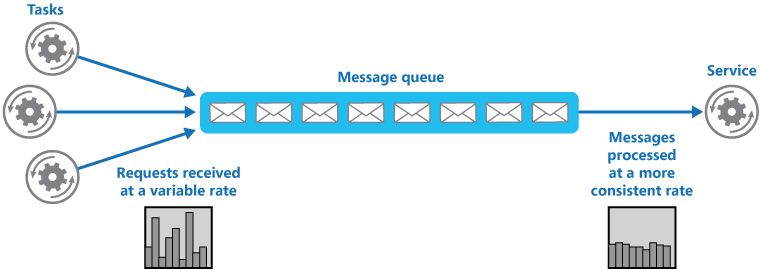

OpenShift utiliza Kubernetes como su orquestador de contenedores subyacente, lo que proporciona capacidades avanzadas de gestión y automatización para los contenedores. Esto incluye el despliegue automatizado, la escalabilidad horizontal, la gestión de recursos y la recuperación ante fallos.

Desarrollo de Aplicaciones en Contenedores

OpenShift simplifica el desarrollo de aplicaciones en contenedores al proporcionar un entorno unificado y colaborativo para los equipos de desarrollo. Ofrece herramientas integradas para la construcción, prueba y despliegue de aplicaciones, así como la integración continua y la entrega continua (CI/CD).

Plataforma Multicloud

OpenShift está diseñado para funcionar en cualquier infraestructura de nube, ya sea en entornos on-premise, en la nube pública o en una combinación de ambos (nube híbrida). Esto proporciona a las organizaciones la flexibilidad necesaria para implementar aplicaciones en el entorno de su elección sin comprometer la portabilidad.

Seguridad Integrada

La seguridad es una prioridad en OpenShift. La plataforma ofrece características de seguridad integradas, como el aislamiento de recursos, el control de acceso basado en roles (RBAC), el cifrado de datos y la detección de amenazas, para proteger las aplicaciones y los datos frente a posibles vulnerabilidades y ataques.

Servicios Administrados

OpenShift proporciona una serie de servicios administrados que simplifican la gestión operativa de la plataforma. Esto incluye la monitorización, la escalabilidad automática, la gestión de registros, la gestión de versiones y las actualizaciones automáticas, lo que permite a los equipos de operaciones centrarse en tareas de valor añadido.

Casos de Uso de Red Hat OpenShift

Red Hat OpenShift es utilizado por organizaciones de todos los tamaños y sectores industriales para una variedad de casos de uso, que incluyen:

- Desarrollo y despliegue de aplicaciones nativas de la nube.

- Modernización de aplicaciones existentes.

- Entrega de aplicaciones en la nube híbrida y multicloud.

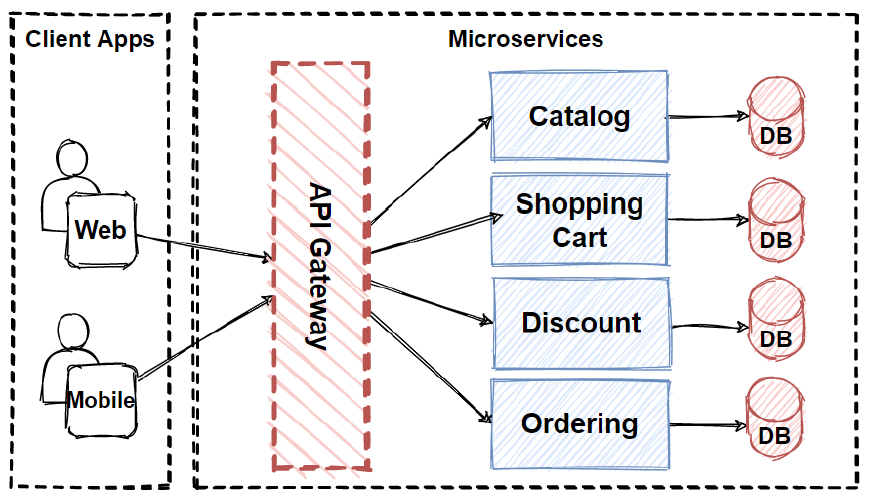

- Implementación de microservicios y arquitecturas basadas en contenedores.

- Gestión de cargas de trabajo de big data e inteligencia artificial.

Red Hat OpenShift ha demostrado ser una plataforma sólida y versátil para el desarrollo de aplicaciones en la nube. Su integración con Kubernetes, su enfoque en la seguridad y la gestión simplificada hacen de OpenShift una opción atractiva para las organizaciones que buscan acelerar la innovación y aumentar la agilidad en un entorno empresarial cada vez más competitivo. Con su compromiso con el código abierto y su amplio ecosistema de socios, Red Hat OpenShift está bien posicionado para seguir liderando el camino en el futuro del desarrollo de aplicaciones en la nube.